AIに心理的なつながりや共感力は必要だろうか。第一生命経済研究所 主席研究員の柏村祐氏と考える。

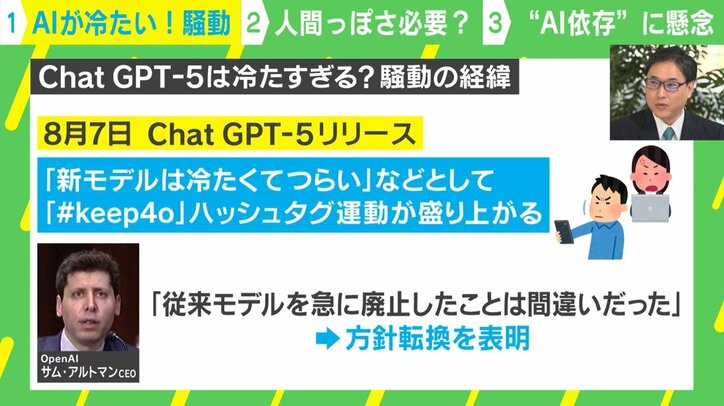

8月7日にリリースされた新モデルのChatGPT-5について、「新モデルは冷たくてつらい」などとしてハッシュタグ運動が盛り上がった。OpenAIの サム・アルトマンCEOは「従来モデルを急に廃止したことは間違いだった」と方針転換を表明している。

柏村氏は、OpenAIにとって“予想外の反応”だったのではないかと述べる。

「アルトマン氏は性能を上げることに注力してGPT-5を出したと思うが、この世間の反応は予想外だったのではないかと思う。生産性を上げるために性能を上げたわけだが、実際には話し相手として使っている人が結構いたことをOpenAIも気づいたのではないか」(柏村祐氏、以下同)

旧モデルのように、AIに“寄り添ってほしい人”はGPT-5をどう使えば良いだろうか。柏村氏は「カスタマイズ機能」の使用を提案した。

「ChatGPTなどにはカスタマイズのモードがあり、寄り添ってくれるような対話など演じてほしい役割を指示すれば、その役割を演じてくれる。機能を使ってみると、また付き合い方が変わると思う」

ではAIの人格変化にショックを受ける人がいることについて、社会的・心理的なリスクはあるだろうか。

「あると思う。ある意味“依存”している。これは、AIと人間の境界線が溶けてきているのだ。海外ではAIにそそのかされて亡くなった人が出る事件も起きた。依存すると取り込まれてしまう人がいるため、多様な人や多様なAIと喋らなければならない。1つのものだけに依存するのは危険」

(『ABEMAヒルズ』より)

この記事の画像一覧