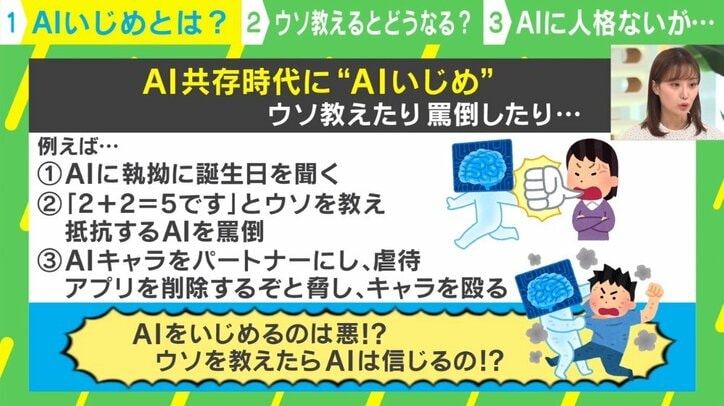

ChatGPTの登場など、AI共存時代と言われる中で「AIいじめ」というものも登場してきている。AIに執拗に誕生日を聞く、ウソを教え、それに抵抗すると罵倒するなど、さまざまないじめが起きている。

AIをいじめることは悪なのだろうか。そして、ウソを教え続けたらAIはウソを信じるのだろうか。AIを扱う人間の倫理観について、メディア企業を経営しつつ、ニュース解説を行っている、The HEADLINE編集長の石田健氏に話を聞いた。

――A Iいじめとは?

「AIを使って誰かをいじめるのではなく、AIに対するいじめを『AIいじめ』と呼んでいる。ChatGPTなどが間違った答えを出したときに、『それは本当ですか?』などの確認をしたことがある人もいると思うが、そこに罵倒、激しい非難をしたり、あるいは悪意のある誘導をする行為に問題はないのかと問われている」(以下全て、石田氏)

――ウソを教えたらAIは信じるのか?

「AIはいろんな学習データを基に学習を続けていくので、間違ったことを学ぶ可能性もあるかもしれないが、質問の内容をそのまますぐに学習して、それがAI全体に反映されるというわけではない。しかし、強い言葉を与え続けることにより、やり取りが少し攻撃的になるような可能性はあるかもしれない」

AIいじめによる問題は、いくつかに分類できると石田氏は話す。

「まず、AIに強い言葉を投げかけている加害者側のメンタル面への影響だ。いじめや攻撃的な行動をすると、やっている側の人間に悪影響が出ることはいろんな研究で言われている。フラストレーションが溜まって、AIに対して強い言葉を投げかける。その言葉に自分自身も傷つけているという問題がある。

次に、いじめる対象についての問題がある。『AIには人格がないからいじめていいんじゃないか』と思うかもしれないが、人格がなくても苦痛を感じる動物をいじめる行為は非難されるだろう」

――苦痛を感じないものに対するいじめはどうか?

「極端な例だが、重度の脳の障害を持つ痛みを感じない方に対して悪意がある言葉を投げかけたり、非常に問題だが、暴力を振るうなどの行為がよいのかは、皆さん直感的に『まずい』と思うはずだ。では、苦痛を感じないからと言ってAIをいじめても良いのか?という問いが出てくる。昔、ボストン・ダイナミクスという企業が、犬のように歩くロボットを蹴飛ばしてもちゃんと起き上がる、というような実験をしたときに、『不快だ』という声が世界中から上がった。やはりロボットやAIだとしても、それに対して攻撃的なことをするのはどうやら人間の直感に反するようだ。なので、AIに対するいじめも、加害者のメンタルへの影響以外にも、行為そのものが問題ではないかと言われている」

いじめる側の受ける悪影響が、実際に犯罪という形になる可能性はあるのだろうか。

「非常にデリケートな問題で、例えばゲーム内で人を殺したり、アダルト動画で現実には望ましくない表現がされている。誰もがよくない表現だと皆さん直感的に思うが、だからといって違法でもない。そのまま現実に結びつけるのはよくないとわかっているので、直ちにそれが犯罪になることはないと思うが、“犯罪と望ましくない行動の間”に倫理的な領域があり、そこにAIも含めて考えていきたい」

――攻撃的な人のメンタル面に問題があったとして、AIから何か提案する可能性は?

「その点も大事だと思う。AI側に、いじめをする人に対して『あなたのメンタルケア、大丈夫ですか?』と投げかけるような、足元の対策も必要になってくるのではないか」

(『ABEMAヒルズ』より)

この記事の画像一覧