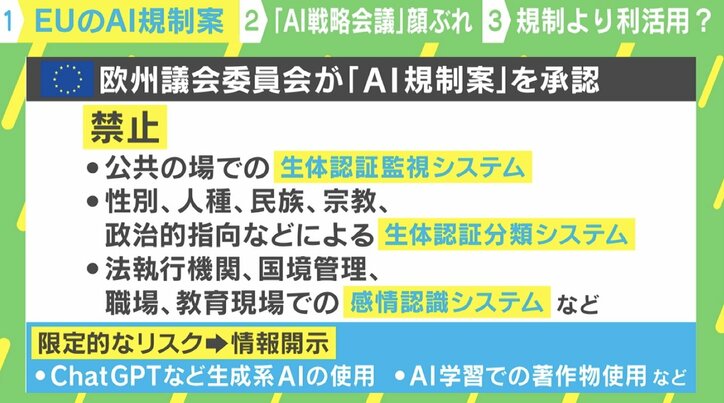

欧州連合(EU)の欧州議会委員会が主要国地域では初となる「AI規制案」を承認した。

【映像】日本も欧州もChatGPTを作れない ではどうする?

使用が禁止された規制を受けることが予測されるのは、以下のようなシステムとなる。

・公共の場での生体認証監視システム

・性別、人種、民族、宗教、政治的指向などによる生体認証分類システム

・法執行機関、国境管理、職場、教育現場での感情認識システムなど

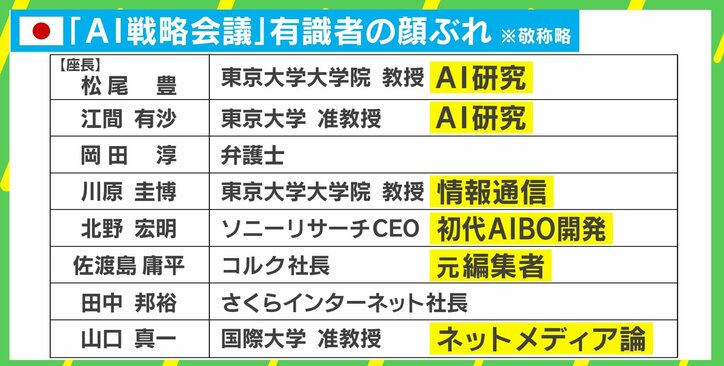

一方、日本でもAIの活用や課題について閣僚や有権者らで議論する「AI戦略会議」の初会合が11日、総理官邸で開催された。

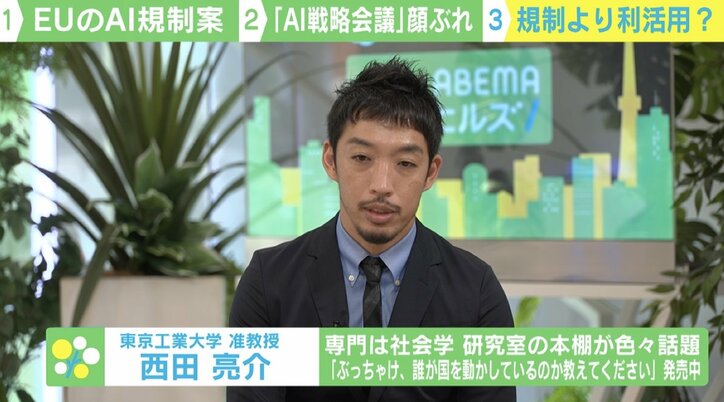

AI研究者や弁護士、開発者などの顔ぶれに対し、東京工業大学・准教授の西田亮介氏は気になる点を挙げた。

「これまでもAI関係の会議は存在していて、そこでは公正にされていた。しかし今回の顔ぶれを見ると、松尾先生や江間先生といったA Iの専門家が並ぶものの、技術系、倫理系、知財、経済系の研究者やビジネスパーソンが中心で、新しい情報技術の利活用や規制のあり方を専門とする制度の研究者や情報法の研究者がいないのが印象的だ」

つまり、規制でなく利活用に向いているのだ。なぜ、日本と欧州で大きく対応が異なるのか。

「例えば、欧州では、事実上、警察による生体認証監視システムなどの許容できないAIシステムは『作ってはいけない』と言っているのに近い。対して日本は2018年に著作権法の大改正があった時に柔軟な権利制限という考え方を導入した。AIも含めた利活用を前提として規制していて、権利者の権利が不当な侵害を受けない限りにおいては基本的にAIにおける学習も認めるという形にかなりはっきりさせた。

また、欧州の場合はAI開発や従来の従来から個人情報の保護とかも同様で、人間中心の原則と言ったりもするが、欧州社会で重要視する人権や人間の脆弱性に対して悪影響を及ぼしそうな(AIの)については、放任ではなくかなり厳しくガバナンスするという印象だ」

AI開発で遅れをとっている日本だが、巻き返すことは可能なのか。

「ChatGPTやマイクロソフトのBingなどと日本語で使えるサービスが増えてきた。しかし、こうしたポピュラーなサービスを投資、開発するだけの体力は日本の大企業にはすでにないといってよさそうだ。ただし、これは日本に限ったことではなく、欧州でみてもほぼ同じだ。事実上、ごく一部のグローバル事業者が独占している感もある。日本は、市場の特性や2018年の著作権法改正等のある種の利点を生かしながら、AI利活用、社会実装の可能性を慎重に探っていく道を歩むのではないか」

(『ABEMAヒルズ』より)

この記事の画像一覧