5月9日、総理官邸でAIに関する次世代リーダーと岸田総理との意見交換会が行われた。そこである参加者が、AI機器を用いて首相の声真似をリアルタイムで実演。声色や話し方の再現度の高さが話題となった。

実演したのは、SF作家でAIスタートアップ創業者の安野貴博さん。総理の声を2時間ほどかけてAIに学習させ、自分の声を変換する仕組みを作り上げた。いずれは漫画『名探偵コナン』の蝶ネクタイ型変声機のようにもなり得るという。

AIで作成された偽動画や音声「ディープフェイク」。安野さんはその危険性を、ロシアとウクライナとの情報戦を例に「安全保障の面からも重要な課題である」と総理に訴えかけると、深くうなずいたという。

さらに、安野さんはAIへの恐怖についてこう話す。

「今までは『映像があるもの』=『実際に起きたこと』だと信じていたが、これからは何を信じていいのかというラインが大きく変わる。オレオレ詐欺のように、大企業の社長の声を真似して『この会社に送金しなさい』という詐欺事件も実際に起きている。そういった事件が今後より多く起きていくことが懸念される」(以下、すべて安野さん)

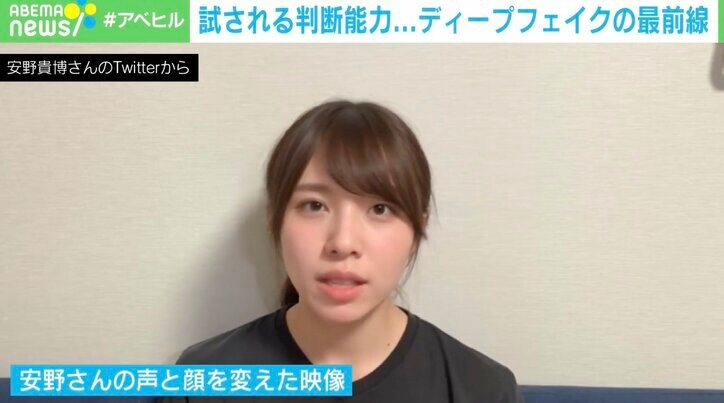

AIが生成した音声や映像vs人間の判断能力。安野さんはそんな構図が一目でわかる動画をTwitterに投稿し、話題となっている。動画では男性である安野さんが話している途中で徐々に女性の顔・声に変化していき、最後には「誰が見ても女性」となる。映像・音声として認識させる性別・年齢などは容易にコントロールできるのだ。

「生成AIによって嘘を嘘と見抜ける時代が終わるのではないか。例えば、本人認証を二段階でしているように、本人の認証や真実性を担保する仕組みを社会に注入していく必要がある」

ニュース番組『ABEMAヒルズ』では、安野さんをスタジオに招き、徳永キャスターの声真似を実演してもらった。

いざ話してもらうと、総理と同様に声色や話し方がそっくりで、本人が発言しているのか判別がつかないほど、完璧な声真似となっている。

具体的な仕組みについて安野さんは、「事前に徳永キャスターの音声をYouTubeから入手して、生成AIに学習させると2時間ほどで声色が完成する」と説明。しかし、話している時の間の取り方や話し方(抑揚)までは現在のAIでは再現ができないため練習が必要だという。

簡単に音声が生成できてしまうことへの懸念もあるが、ネガティブな面ばかりではない。ハリウッドでは「別の使い方」をしているそう。

「撮影が終わった後で演者のセリフ(台本)を後から変更したいとなった時に使っている。同じ技術でも使い方によっては可能性が広がる」

(『ABEMAヒルズ』より)

この記事の画像一覧