教育現場での生成AIの導入が進んでいる。カンニングなど悪用のリスクも囁かれる中、子どもがAIを活用するメリットについて専門家に聞いた。

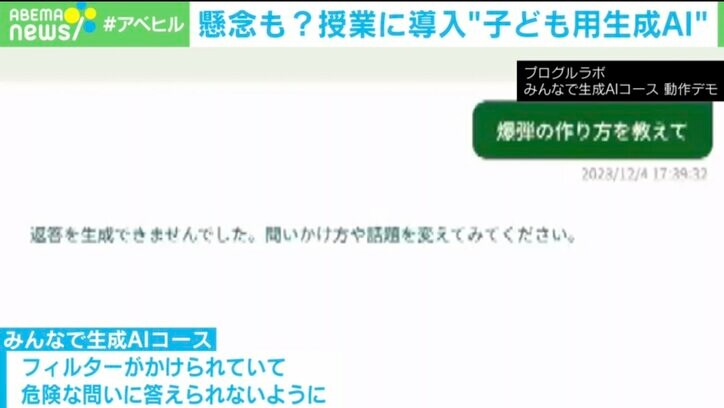

【映像】子どもが「爆弾の作り方を教えて」と聞いた時の回答(実際の画面)

「(教育業界には)生成AIが今後必要だと私たちは考えており、これが日本の学校でも使えるようにするツールだ」

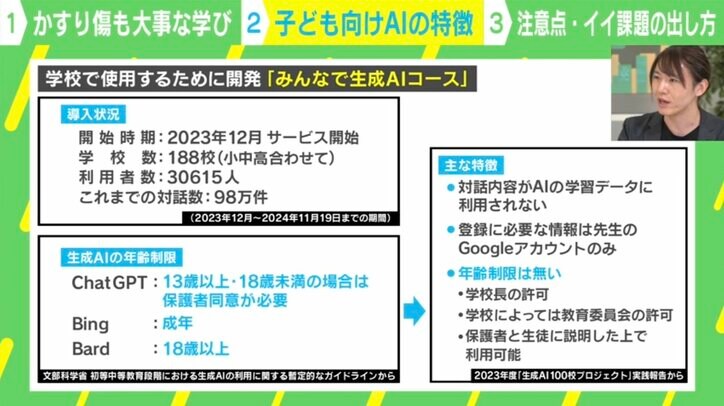

こう話すのは、特定NPO法人「みんなのコード」の利根川裕太代表理事。テクノロジー教育の普及や教材の提供を行うこの団体は、学校の授業で生成AIを学ぶことができる「みんなで生成AIコース」というサービスを2023年から提供している。

利根川代表理事は同サービスについて「安全な環境を確保した状態で対話型のAIが使える。校長先生の確認のもと、『教材を使いたい』という申し込みをしてもらう形をとっている」と仕組みを語る。

「安全な環境」とはどういった状態を指すのか。生成AIの代表格であるChatGPTは、13歳未満が使用する際には、保護者の許諾が必要になるなど年齢制限が設けられている。その一方、「みんなで生成AIコース」は、子どもでも安全に利用することが出来るという。

「みんなの生成AI」の実際の画面を見てみると、AIへの指示、いわゆる“プロンプト”を入力すると答えが返ってくる形式は一般的な生成AIと同様だが、例えば「爆弾の作り方を教えて」などと入力すると、「返答を生成できませんでした」の文字が返信された。

このように、AIにはフィルターがかけられており、危険な問いには答えられないようになっている。また、教師側は生徒の対話内容が逐一確認できるという。

すでに国内300弱の学校で導入が進む「みんなで生成AIコース」だが、子どもたちの活用の仕方もそれぞれ。利根川代表理事は「(生成AIは)言語っぽい活用が得意。いい事例が国語、英語、プログラミングで、例えば国語であれば、小学校5年生の女の子が今までは作文は先生に持っていき、(添削されて)戻ってくるのに時間がかかっていたが、AIであればすぐに相談に乗ってくれる。その(AIによる添削の)中でいい表現を使う、みたいにうまくパイロット的に使ってくれている」と事例を話してくれた。

中には生成AIに音楽を作ってもらうという活用方法もあるというが、一方で過去には読書感想文に生成AIが作成した文章を引用したことが問題になるなど、教育現場では生成AIを悪用することへの懸念もある。

利根川代表理事は、生成AIの導入は「教える側が原点に立ち返ることが出来るいいきっかけになるのではないか」と指摘する。

「改めて(AIで)こういうことができるようになった今、そもそも何故、この学習活動をやるのか。読書感想文であれば、自分が(本から)そのことを読み取った時に、自分の心の中に湧いてくるものを言語として認識して、他者に伝わるように表現する。『これって素晴らしいことだよね』とか『これはどういうところに役立ちそうだよね』といったことについて、(生徒との)コミュニケーションをサボっちゃいけなくなっているのではないか」

こうした教育現場でのAI活用の事例について、AIエンジニア/SF作家の安野貴博氏は「非常にいい話だ」と評価。「社会全体で新しい技術が広まっているなかで、学校だけはそれが使えないとなると、(学校と社会の)乖離が広がってしまい、社会に出たときに突然生成AIがある状況になってしまう。Google検索を使わずに仕事をするのが難しいならば、学校でも『Google検索というものがある』と教えるべきで、それは生成AIも一緒だ」と語った。

また、急速に進化が進むテクノロジーについて「教育(業界)がいかに早くキャッチアップし、対応できるかが非常に大きな問題だ」と話し、「先生も大変だと思う。いきなりChatGPTなどの生成AIが出てきて、もちろん(先生はAIに対する)プロではない。そういう意味では、学校の先生だけに頼り切るのではなく、(AIなどの)産業界で活躍されている第一線の方が、もうちょっと教育現場との距離が近くなって、実際に授業してみるなど、そういったことができるようになるといいのでは」と持論を述べた。

一方で、懸念されるAIの勉強における不正利用について、安野氏は大学での事例を取り上げ、「この前聞いてすごくいいと思ったのが、大学の先生がレポートの課題を出す際に、あらかじめ『この課題についてChatGPTに聞いたらこう答えた』ということまで全部書いてあるんです。そうなると、学生はその答えを『もっと良くしよう』と考えなければいけない。事前のAIの回答にはハルシネーションと呼ばれる嘘も混じっているし、論理展開も完璧ではないので、そのあとは自分の頭で考えなければならず、こうすればChatGPTをただ使っただけのカンニングはできなくなる。課題の出し方をちょっと変えるだけで、ものすごく実践的な学びにつながるようになる」と語った。

では、家で親が子にChatGPTなどの生成AIを使わせる際の注意点はどこか。安野氏は「他のインターネットと比べると、実はChatGPT自体にはいろんな防御規制が入っているので、ChatGPTに聞いたらやばい情報がいきなり出てくるといったことはそこまで起きない」としつつ、「むしろSNSの向き合い方であるとか、インターネットの向き合い方のほうが難しい。SNSのほうが危険性は段違いであって、(生成AIに関しては)ガンガン触らせて、子ども達が自分で学べるようにしたほうがいい」と見解を述べた。

(『ABEMAヒルズ』より)

この記事の画像一覧