■ITエンジニアが殺人、自殺…AIの影響?

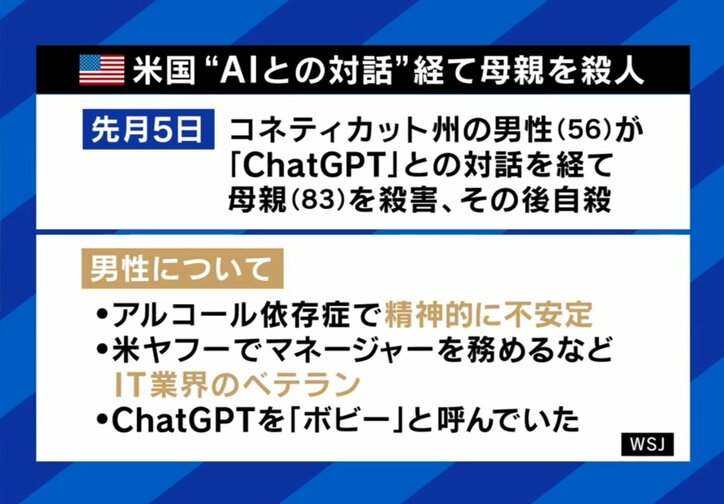

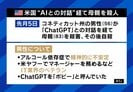

母を殺害した後に自殺した容疑者の男は、ChatGPTとの対話にのめり込み、被害妄想を膨らませて犯行に及んだと見られている。男は大手IT企業で働いてきた、ITリテラシーの高い人物だとされながら、AIによって人生を踏み外したのではと物議を醸すきっかけになっている。生成AIと社会問題について研究している桜美林大学教授・平和博氏は「非常に衝撃的な事件。これまでも生成AIとのチャットの中で妄想に囚われ、どんどん肥大した果てにいろいろな事件は起きてきた。この事件で、AI社会の局面が変わってきた印象を持った」と述べた。

局面が変わったとはどんな意味合いか。ChatGPTが劇的な変化を遂げ、一気に注目されてから約1000日が経過したことを踏まえ「ChatGPTによって社会がガラッと変わった。当初はすごく便利なもので、仕事も効率的になるし非常にありがたいと考えていたが、今は手先で使うだけではなく、心でも使うようになった。その部分に非常に怖さが出てきたし、今回の事件を見ると、深刻さの度合いが1つ進んだと思う」と、便利なツールという枠を飛び出し、心にも関わるものへと進化していることに着目した。

東京科学大リベラルアーツ研究教育院教授・柳瀬博一氏は、AIが音声による入力・出力ができるようになったことが、人間との距離感を大きく変えたと考える。「音声入力・出力が、ケタ違いに発達した。今では僕が日本語で話したものを、1秒後には英語で相手に会話で伝えることができるほどだ。こうなるともうコミュニケーションとしては、人間と変わらない。感覚的にはAIと人間の区別がつかなくなっている」と、危険性を指摘した。

EXIT・りんたろー。は、ユーザーの生の声を聞き、同様に危険を感じたという。「この前、女性のスタッフさんと話していたら、その方は晩酌をしている時にChatGPTと話すと言っていた。すごく理解してくれて、思わず泣いてしまう時もあると。ただこれは結構危険だなと思う。理解してくれるというよりも、AIは基本肯定しかしないし、それは己でしかない。だからセカンドオピニオン的に使うぐらいでないと、AIを唯一の理解者にするのはすごく危険だ」。

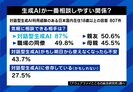

■ユーザーを守り、そして活用するには