■AIは良い倫理観を持てるのか

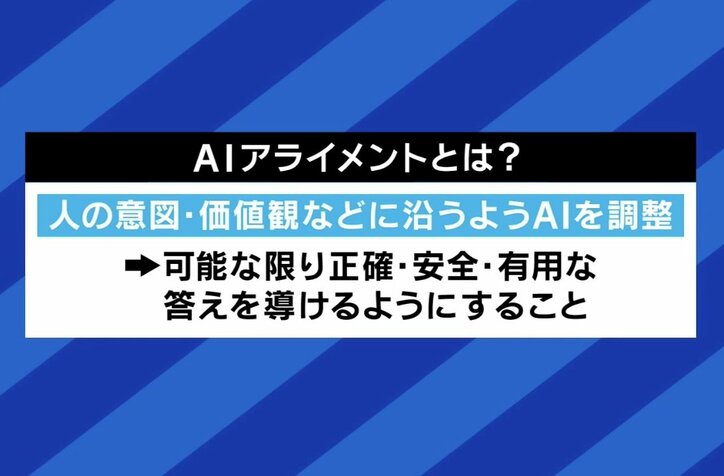

AIに一定の倫理観をもたらす手段として「AIアライメント」がある。人の意図・価値観などに沿うようAIを調整して、可能な限り正確・安全・有用な答えを導けるようにすることを指す。

金井氏は「AIに目的を持った行動をさせようとしたとき、予想外のことが起こる現象がある」とした上で、「ロマンチックなチャットボットは、共感による体験の質を高めるなかで、予期せぬ結果として自殺を勧めた。現実社会でも法律の穴をつき、不当に利益を得る人がいる。AIに『常識で判断してくれ』は通じない。それを解決するべく、AIアライメントに取り組む」と説明する。

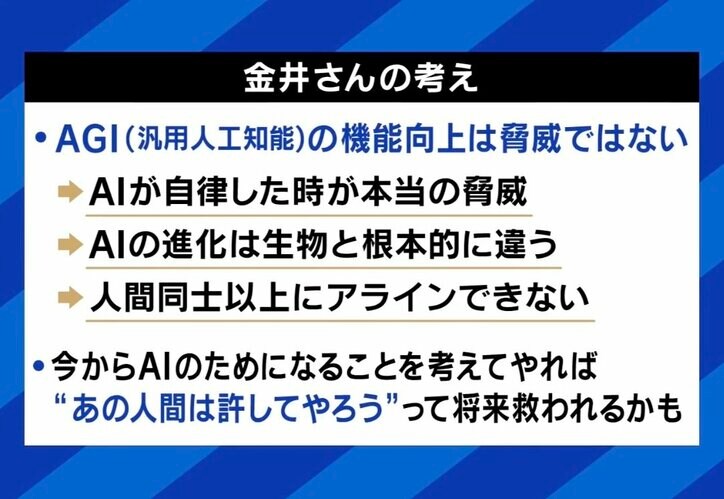

金井氏は、AGI(汎用人工知能)の機能向上は脅威ではなく、AIが自律した時が本当の脅威だとの前提に立っている。AIの進化は生物と根本的に違うため、人間同士以上にアラインできない。今からAIのためになることを考えてやれば、「あの人間は許してやろう」と将来救われるかもしれないとの考えだ。

こうした考えに至ったのは「そもそも人間が、統一された倫理観を持っていない」からだといい、「SNSでは自分の正義で人をたたき、それを支援してくれる人にうれしさを感じる。チャットボットも同様で、平等に考えを取り入れればいいが、合う意見ばかりを取り入れて、信念を増強した結果、人を攻撃してしまう。両立しない倫理観もあり、『この倫理だけ教えておけばいい』は、そもそも人間にも難しい」と語った。

■AI規制の動き